LaMDA

| מפתח |

חברת גוגל |

|---|---|

| מחזור חיים |

2020–הווה (כ־4 שנים) |

LaMDA (Language Model for Dialogue Applications בעברית:מודל שפה ליישום דיאלוג) היא משפחה של מודלי שפה גדולים שפותחה על ידי גוגל.

הרעיון פותח והוצג במקור בשם Meena בשנת 2020, הדור הראשון של LaMDA הוכרז במהלך 2021 Google I/O המרכזי, בעוד הדור השני הוכרז בשנה שלאחר מכן. ביוני 2022, LaMDA זכה לתשומת לב נרחבת כאשר מהנדס גוגל, בלייק למוין העלה טענות שהצ'אטבוט של LaMDA הפך לרגיש ומודע לעצמו. הקהילה המדעית דחתה במידה רבה את הטענות של למוין, אך עדותו הובילה לשיחות על היעילות של מבחן טיורינג, שמודד אם מחשב יכול לעבור לאדם. בפברואר 2023, גוגל הכריזה על Bard, צ'אטבוט של בינה מלאכותית לשיחה המופעל על ידי LaMDA, כדי להתמודד עם הוצאת ChatGPT של OpenAI.

היסטוריה

[עריכת קוד מקור | עריכה]רקע כללי

[עריכת קוד מקור | עריכה]ב-28 בינואר 2020, גוגל חשפה את Meena, צ'אט בוט המופעל על ידי רשת נוירונים עם 2.6 מיליארד פרמטרים, שגוגל טענה שהם עדיפים על כל שאר הצ'אטבוטים הקיימים.

החברה שכרה בעבר את מדען המחשב ריי קורצווייל ב-2012 כדי לפתח מספר צ'אטבוטים עבור החברה, כולל אחד בשם דניאל. צוות המחקר של Google Brain, שפיתח את Meena, קיווה לשחרר את הצ'אטבוט לציבור בתפוסה מוגבלת, אך מנהלי תאגידים סירבו בטענה שMeena הפרה את "עקרונות ה-AI סביב בטיחות והגינות" של גוגל. מאוחר יותר שונה שם ל-Mena ל-LaMDA כשהנתונים וכוח המחשוב שלה גדלו, וצוות Google Brain ביקש שוב לפרוס את התוכנה ל-Google Assistant, תוכנת העוזר הווירטואלי של החברה, בנוסף לפתיחתה להדגמה ציבורית. שתי הבקשות נדחו שוב על ידי הנהגת החברה מה שהוביל בסופו של דבר את שני החוקרים הראשיים של LaMDA, דניאל דה פרייטס ונועם שזיר, לעזוב את החברה בתסכול.

דור ראשון

[עריכת קוד מקור | עריכה]שנתיים לאחר מכן, גוגל הכריזה על מודל שפה גדול של LaMDA במהלך ההרצאה המרכזית של Google I/O ב-18 במאי 2021, המופעלת על ידי בינה מלאכותית. המערכת נבנתה על ארכיטקטורת seq2seq, רשתות עצביות ומבוססות טרנספורמרים שפותחו על ידי Google Research בשנת 2017, LaMDA הוכשרה על דיאלוג אנושי וסיפורים, מה שמאפשר לה להשתתף בשיחות פתוחות.

גוגל מצהירה כי התגובות שנוצרו על ידי LaMDA הובטחו להיות "הגיוניות, מעניינות וספציפיות להקשר". לLaMDA יש גישה למספר רב של מערכות עיבוד טקסט סימבולי, כולל מסד נתונים, שעון ולוח שנה בזמן אמת, מחשבון מתמטי ומערכת תרגום שפה טבעית, המעניקה לו דיוק מעולה במשימות הנתמכות על ידי מערכות אלו. LaMDA אומן על בסיס תשעה מדדי ביצוע ייחודיים: הגיון, ספציפיות, עניין, בטיחות, חיבור למציאות, אינפורמטיביות, דיוק ציטוטים, מועילות ועקביות תפקיד.[1]

דור שני

[עריכת קוד מקור | עריכה]ב-11 במאי 2022, גוגל חשפה את LaMDA 2, היורש של LaMDA, במהלך 2022 Google I/O Keynote. הגלגול החדש של המודל שואב דוגמאות של טקסט ממקורות רבים, תוך שימוש בו לניסוח "שיחות טבעיות" ייחודיות בנושאים שאולי לא הוכשר להגיב אליהם.

טענות משפטיות

[עריכת קוד מקור | עריכה]

ב-11 ביוני 2022, הוושינגטון פוסט דיווח כי מהנדס גוגל בלייק למוין הוצא לחופשה מנהלית בתשלום לאחר שלמוין אמר למנהלי החברה בלייז אגאורה אי ארקס וג'ן ג'נאי ש-LaMDA הפך לרגיש. למוין הגיע למסקנה זו לאחר שהצ'אטבוט השיב תשובות מפוקפקות לשאלות הנוגעות לזהות עצמית, ערכי מוסר, דת ושלושת חוקי הרובוטיקה של אייזק אסימוב.

גוגל דחתה את הטענות הללו, ועמדה על כך שיש ראיות משמעותיות המצביעות על כך ש-LaMDA לא היה מודע. בראיון ל - Wired, למוין חזר על טענותיו כי LaMDA הוא "אנושי" כפי שהוכתב על ידי התיקון ה-13 לחוקה האמריקאית, והשווה זאת ל"אינטליגנציית חייזר ממוצא יבשתי". עוד הוא חשף כי הוא פוטר על ידי גוגל לאחר ששכר עורך דין, לאחר שהצ'אטבוט ביקש מלמוין לעשות זאת. ב-22 ביולי, גוגל פיטרה את למוין בטענה כי בלייק הפר את המדיניות שלהם "לשמירה על מידע על המוצר" ודחתה את טענותיו כ"מופרכות לחלוטין". מחלוקת פנימית שהתעוררה בעקבות התקרית גרמה למנהלי גוגל להחליט שלא לשחרר את LaMDA לציבור, שהיא שקלה בעבר.

הטענות של למוין נדחו רבות על ידי הקהילה המדעית. מומחים רבים לעגו לרעיון שמודל שפה יכול להיות מודע לעצמו, כולל הפרופסור לפסיכולוגיה לשעבר באוניברסיטת ניו יורק גארי מרקוס, דייוויד פאו מחברת האחות של גוגל DeepMind, אריק בריינג'ולפסון מהמכון לבינה מלאכותית ממוקדת בבני אדם באוניברסיטת סטנפורד והאוניברסיטה של פרופסור סארי אדריאן הילטון. יאן לקון, שמוביל את צוות מחקר הבינה המלאכותית של Meta Platforms, הצהיר כי רשתות עצביות כגון LaMDA "אינן חזקות מספיק כדי להשיג אינטליגנציה אמיתית". פרופסור מקס קרמינסקי מאוניברסיטת קליפורניה, סנטה קרוז, ציין כי הארכיטקטורה של LaMDA לא "תמכה בכמה יכולות מפתח של תודעה דמוית אדם" וכי משקלי הרשת העצבית שלה "קפאו", בהנחה שמדובר במודל שפה גדול טיפוסי.

המפתח הראשי של IBM ווטסון, דייוויד פרוצ'י, השווה את האופן שבו נראתה LaMDA אנושית באותו אופן שבו ווטסון עשה כשהוצג לראשונה. ראש תחום ההאתיקה לשעבר של גוגל AI, תמנית גברו, כינתה את למוין קורבן של "מחזור הייפ" שיזמו חוקרים ותקשורת. הטענות של למוין יצרו גם דיון בשאלה האם מבחן טיורינג נשאר שימושי כדי לקבוע את התקדמות החוקרים לקראת השגת בינה מלאכותית חזקה.

מוצרים

[עריכת קוד מקור | עריכה]AI Test Kitchen

[עריכת קוד מקור | עריכה]עם חשיפת LaMDA 2 במאי 2022, גוגל השיקה גם את AI Test Kitchen, אפליקציה סלולרית למערכת ההפעלה אנדרואיד המופעלת על ידי LaMDA המסוגלת לספק רשימות של הצעות לפי דרישה המבוססות על מטרה מורכבת. האפליקציה הייתה פתוחה במקור רק לעובדי גוגל, והיא אמורה להיות זמינה ל"בחינת אקדמאים, חוקרים וקובעי מדיניות" בהזמנה מתישהו במהלך 2023. באוגוסט 2022 החלה החברה לאפשר למשתמשים בארצות הברית להירשם לגישה מוקדמת. בנובמבר, גוגל פרסמה עדכון לאפליקציה, המשלב צורה מוגבלת של מודל הטקסט לתמונה Imagen של Google Brain. איטרציה שלישית של AI Test Kitchen הייתה בפיתוח בינואר 2023, וצפויה להיות מושקת ב-I/O מאוחר יותר באותה שנה.

בארד

[עריכת קוד מקור | עריכה]ב-6 בפברואר 2023, גוגל הכריזה על Bard, צ'אטבוט של AI לשיחה המופעל על ידי LaMDA, בתגובה לפופולריות הבלתי צפויה של ChatGPT של OpenAI. גוגל ממצבת את הצ'אט בוט כ"שירות AI שיתופי" ולא כמנוע חיפוש. בארד הפך זמין לגישה מוקדמת ב-21 במרץ 2023

מוצרים אחרים

[עריכת קוד מקור | עריכה]בנוסף לבארד, פיצ'אי גם חשף את ה-Generative Language API של החברה, ממשק תכנות יישומים המבוסס גם הוא על LaMDA, שעליו הודיע כי ייפתח למפתחי צד שלישי במרץ 2023.

שיטה

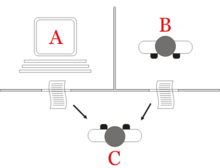

[עריכת קוד מקור | עריכה]LaMDA מאומן מראש על קורפוס טקסט הכולל מסמכים ודיאלוגים המורכבים מ-1.56 טריליון מילים, ולאחר מכן מאומן עם נתונים וכוונון עדין (fine-tuning) שנוצרו על ידי תגובות מוערות ידנית לצורך הגיון, עניין ובטיחות. בדיקות של גוגל הצביעו על כך ש-LaMDA עלה על התגובות האנושיות בתחומים שונים. מודל LaMDA ומערכת אחזור מידע חיצונית פועלים באינטראקציה כדי לשפר את דיוק העובדות המסופקות למשתמש.

ראו גם

[עריכת קוד מקור | עריכה]קישורים חיצוניים

[עריכת קוד מקור | עריכה]הערות שוליים

[עריכת קוד מקור | עריכה]- ^ Thoppilan et al. 2022, pp. 5–6.